近年のコンピュータビジョン技術や計算資源の進歩により、リアルタイムな物体検出アプリケーションをiOS端末上で開発するのは以前よりも容易になりました。ですが、検出ロジックの実装は開発におけるほんの一部です。ユーザフレンドリーなアプリケーションとするためには、インタラクションとうまく組み合わせ、適切なフィードバックをユーザに与えることが不可欠です。このライトニングトークでは、カメラ中の名刺を即座にスキャンするWantedly PeopleというiOSアプリを開発するにあたって、より良いフィードバックを与える上で我々がどのような問題に直面したか、それをどう解決したかをお話します。

リアルタイム物体検出アプリでよりよいフィードバックを提供する

画像や動画から、例えば猫の顔を検出します。

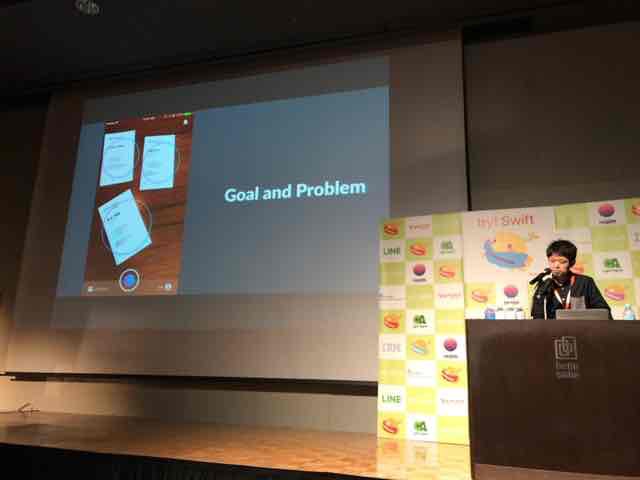

名刺管理アプリを作りました。複数の名刺を検出できます。

検出ロジックはすでにある想定です。

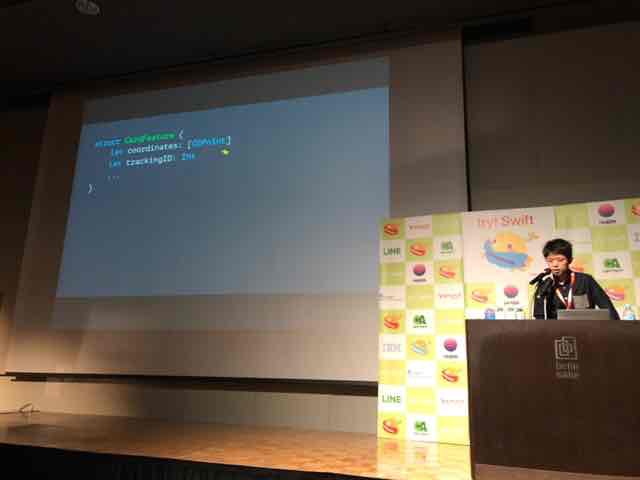

座標が分かっている状態です。

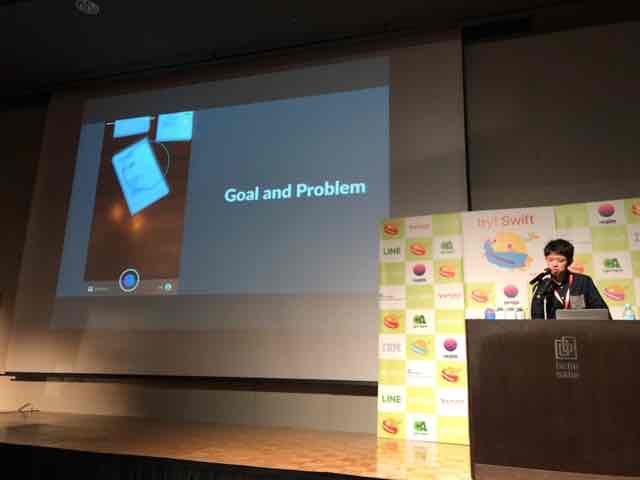

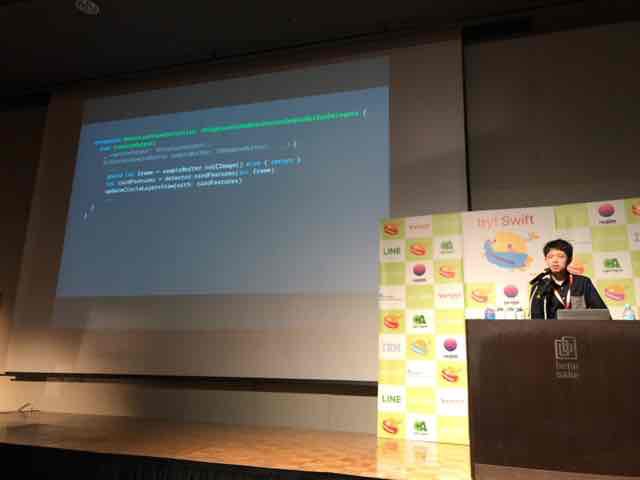

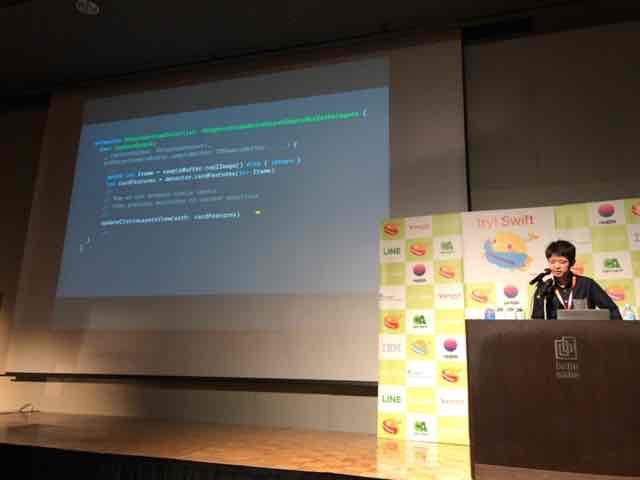

AVFoundationで

各フレームで円を再描画します

しかしこれだけではジャギーです

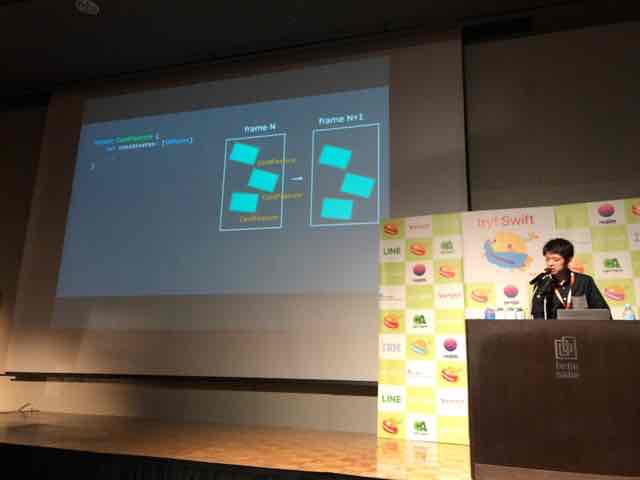

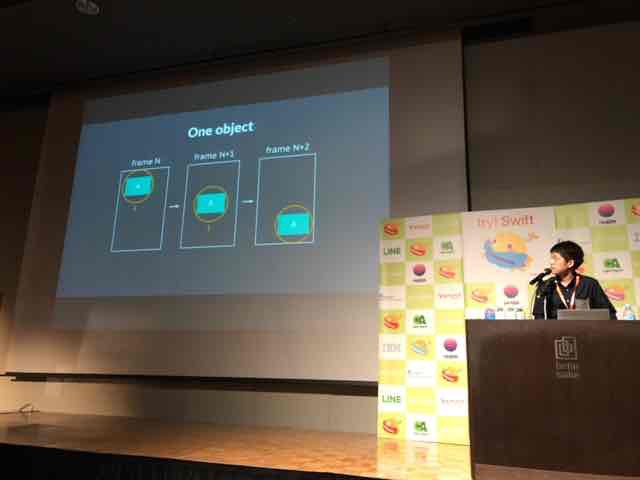

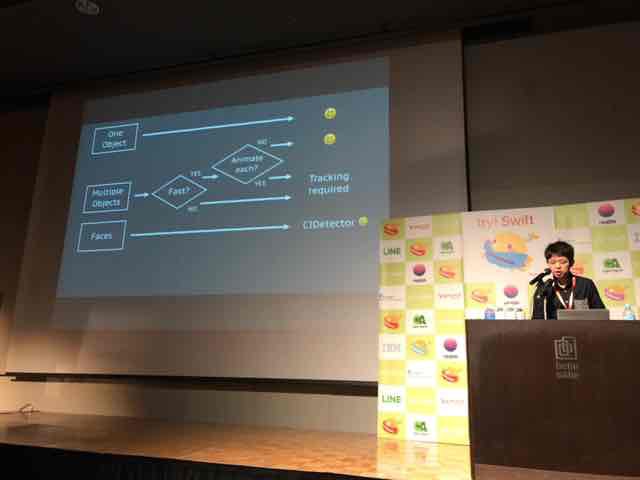

1つのオブジェクトを検出するだけなら簡単です。

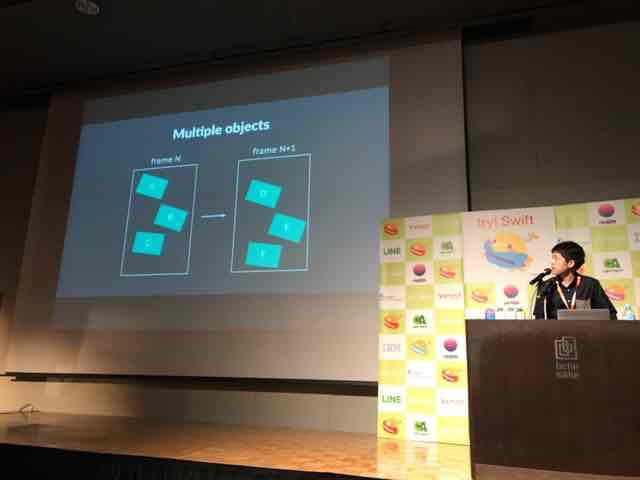

人間なら簡単にA, B, Cを認識できますが機会はできません。

トラッキングが必要になります。

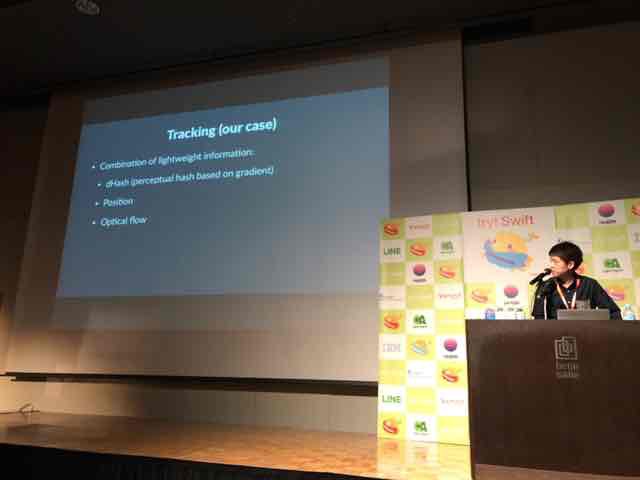

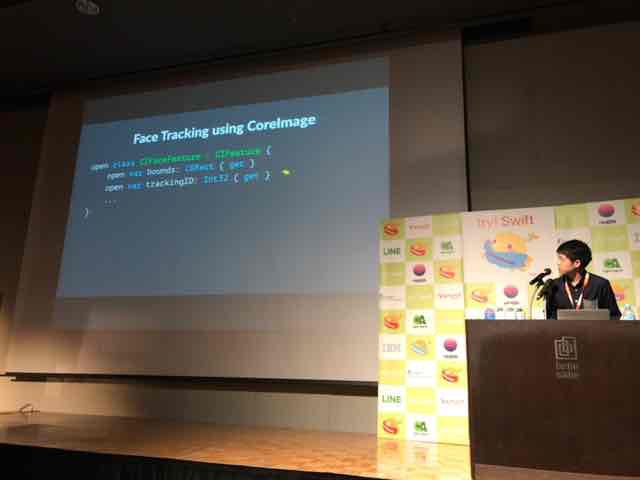

OpenCVでは一部のiOSデバイスで性能上の問題が有りました。

個々にある3つの情報を組み合わせています。

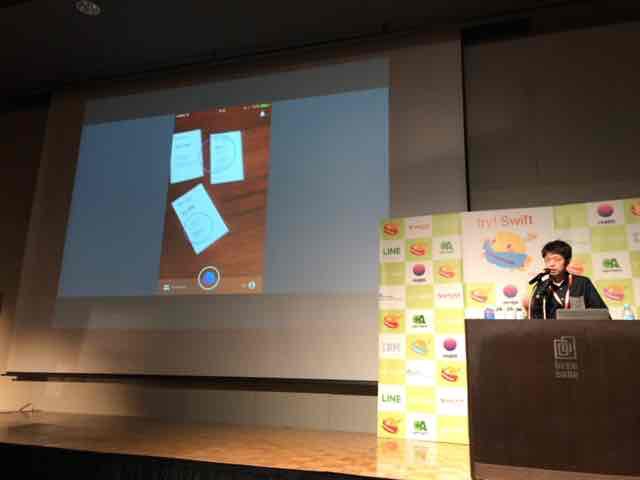

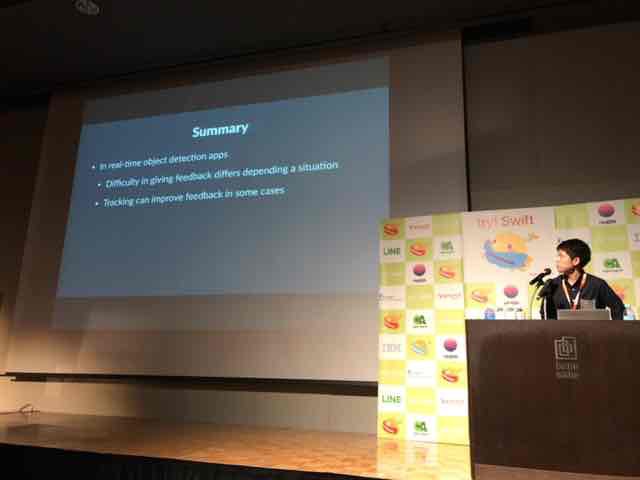

トラッキングできたことで円をアニメーションさせることが出来るようになりました。

こうすることでユーザーはより動きがわかるようになります

このアプリに限定されたことでしょうか

何を検知したいのか、どのぐらい検知に時間がかかるのかによります

トラッキング機能によってフィードバクを改善できることが有ります。 検知プロセスだけではなくて、最初からトラッキングについても考えるととても良いと思います。